Từ khi ChatGPT được ra mắt vào năm 2022, đã làm bùng nổ một nhu cầu công việc mới – các kỹ sư lời nhắc – hay các promts engineer. Họ có thể diễn đạt câu hỏi hay yêu cầu một cách phù hợp để các mô hình ngôn ngữ hoặc các công cụ tạo hình ảnh, nội dung đa phương tiện có thể hiểu được và đưa ra kết quả tốt nhất – thậm chí vượt qua các giới hạn của những công cụ AI này.

Với xu hướng nhà nhà, người người dùng AI, đặc biệt là các công ty, các tổ chức lớn, thậm chí cả các công ty công nghệ cũng đang tìm tới AI tạo sinh, nhiều người cho rằng, trong tương lai, các kỹ sư lời nhắc này chính là "vua nghề" mới trong tương lai, thay thế cho vị trí hiện tại của các lập trình viên. Điều này càng được khẳng định hơn khi một số báo cáo cho thấy mức lương cao ngất – đến hàng trăm nghìn USD mỗi năm – đang được sử dụng để mời chào những kỹ sư lời nhắc.

Nhưng một nghiên cứu mới đây cho thấy hóa ra công việc này lại có thể phải đối diện với cảnh "sớm nở, chóng tàn" bởi chính loại công nghệ đã giúp họ trở nên nổi tiếng – các mô hình AI.

Tăng cường hiệu suất cho các mô hình AI

Trong nghiên cứu của mình, Rick Battle và Teja Gollapudi – 2 kỹ sư tại công ty phần mềm đám mây VMware – nhận thấy hiệu suất của các mô hình ngôn ngữ lớn biến động bất thường theo các lời nhắc kỳ quặc. Ví dụ, khi các mô hình được yêu cầu giải thích từng bước hành động của mình – một kỹ thuật được gọi là chain-of-thought – nó sẽ cải thiện hiệu suất đối với các câu hỏi toán học và logic. Thậm chí một số lời nhắc tích cực như "điều này thú vị đấy" hoặc "bạn thông minh như ChatGPT" đôi khi cũng cải thiện hiệu suất.

Từ đó, 2 kỹ sư này quyết định thử nghiệm một cách hệ thống các kỹ thuật lời nhắc khác nhau để đánh giá tác động của nó đến hiệu suất của các mô hình ngôn ngữ trong việc giải các câu hỏi toán học của cấp trung học. Phép thử của họ được thực hiện với sự kết hợp 60 kiểu lời nhắc cho 3 mô hình AI mã nguồn mở khác nhau. Điều đáng ngạc nhiên là kết quả lại không nhất quán – "Chỉ có duy nhất một xu hướng thực sự là không có xu hướng nào" – các nhà nghiên cứu cho biết.

Một giải pháp thay thế cho phương pháp lời nhắc thử-sai này là yêu cầu chính các mô hình AI đưa ra lời nhắc được tối ưu cho riêng nó. Khi dùng thử các công cụ này, Battle và các đồng nghiệp của mình nhận ra rằng, trong hầu hết các trường hợp, các lời nhắc được tạo ra mang lại hiệu suất tốt hơn hầu hết cách làm thường thấy của con người. Hơn nữa, cách làm này còn mang lại kết quả nhanh hơn, chỉ mất vài giờ thay vì vài ngày thử-sai.

"Nhiều người tìm cách nhân cách hóa những công cụ này bởi vì chúng "nói tiếng Anh" – hoàn toàn không đúng. Chúng không nói tiếng Anh. Chúng làm toán." Battle cho biết. Và vì vậy, việc tối ưu hóa các lời nhắc phải dựa trên bản chất thật sự của các mô hình AI – chính là các mô hình.

Do vậy, từ kết quả nghiên cứu của nhóm mình, Battle cho rằng con người không nên tìm cách tối ưu hóa các lời nhắc mô hình AI thủ công nữa. Thay vào đó, "chỉ cần phát triển một tiêu chí đánh giá để hệ thống tự xác định xem lời nhắc nào tốt hơn lời nhắc nào, và sau đó để mô hình tự tối ưu hóa."

Lời nhắc tự động giúp các hình ảnh đẹp hơn

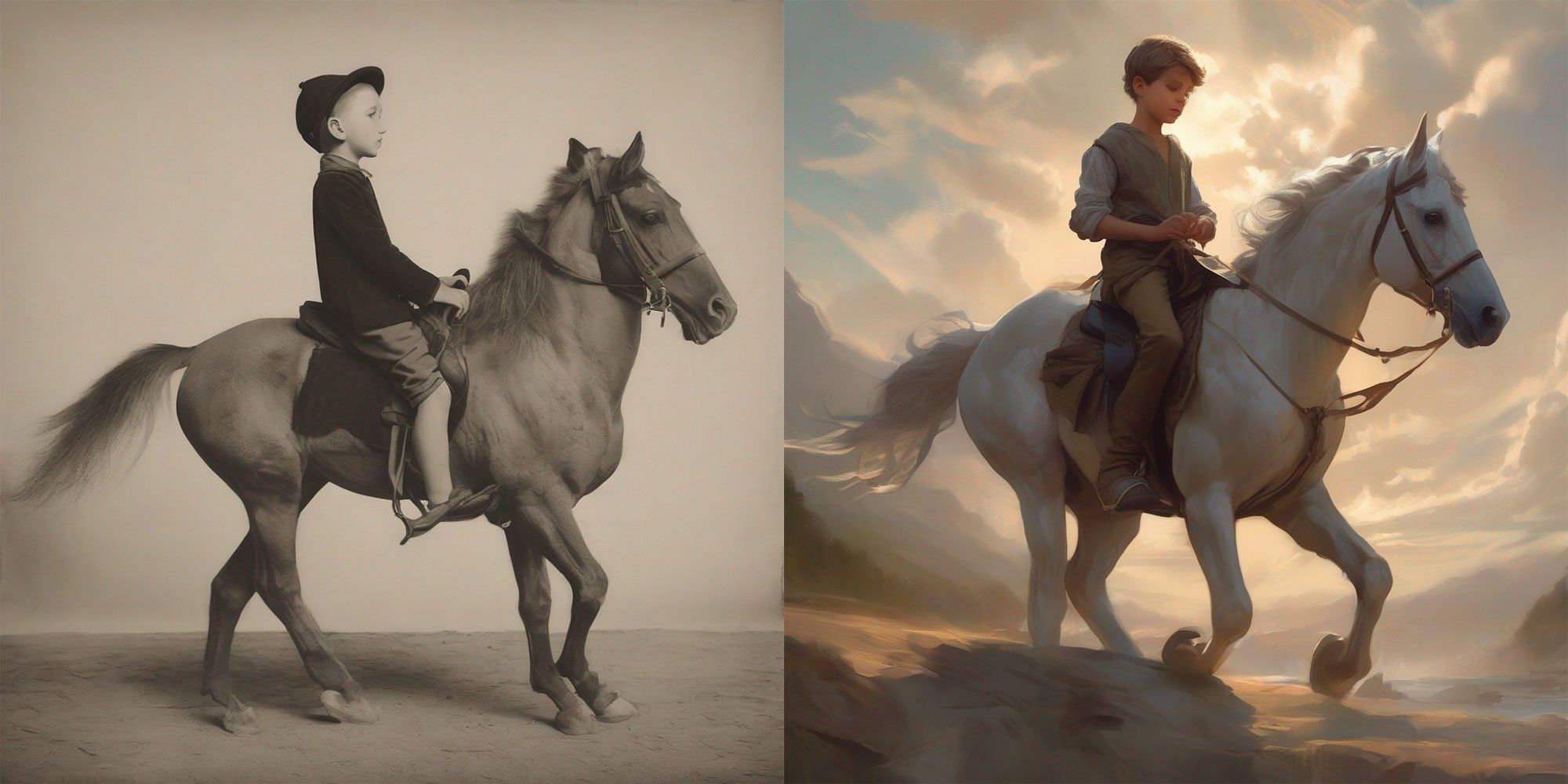

Không chỉ giải toán hay các bài logic, các lời nhắc tự động cũng giúp tạo sinh nên các hình ảnh đẹp hơn. Gần đây, một nhóm nghiên cứu khác phòng thí nghiệm của Intel, dưới sự lãnh đạo của Vasudev Lal, đã bắt đầu một nhiệm vụ tương tự để tối ưu hóa lời nhắc cho Stable Diffusion, một công cụ AI tạo hình ảnh nổi tiếng.

Nhóm của Lal đã tạo ra một công cụ gọi là NeuroPrompts, dùng một lời nhắc đầu vào đơn giản, như "cậu bé trên một con ngựa," và tự động tăng cường nó để tạo ra một bức ảnh đẹp hơn.

Trái là hình ảnh ban đầu được Stable Diffusion tạo ra bằng lời nhắc thông thường và Phải là hình ảnh dược tạo ra bởi NeuroPrompts

Để làm điều này, họ bắt đầu với một loạt các lời nhắc do những chuyên gia lời nhắc con người tạo ra. Sau đó, họ đã huấn luyện một mô hình ngôn ngữ để biến đổi các lời nhắc đơn giản thành các chuyên gia lời nhắc. Từ đó, họ đã sử dụng kỹ thuật học tăng cường để tối ưu hóa các lời nhắc này nhằm tạo ra những hình ảnh đẹp mắt hơn, khi được đánh giá bởi một mô hình học máy khác, PickScore, một công cụ đánh giá hình ảnh mới được phát triển gần đây.

Lại một lần, các lời nhắc tự động do mô hình AI tạo ra cũng thực hiện tốt hơn các chuyên gia lời nhắc được sử dụng làm điểm xuất phát ban đầu, ít nhất theo điểm số của PickScore. Lal không bất ngờ về điều này. "Con người chỉ làm điều đó bằng thử và sai. Nhưng giờ chúng tôi có một vòng lặp hoàn chỉnh, được tự động hóa hoàn toàn và được hoàn thành với học tăng cường. … Đó là lý do tại sao chúng tôi có thể vượt trội hơn các kỹ sư lời nhắc con người."

Lal tin rằng khi các mô hình AI tạo sinh phát triển, việc phụ thuộc vào những lời nhắc kỳ quặc sẽ biến mất. "Tôi nghĩ điều quan trọng là những loại tối ưu hóa này phải được nghiên cứu và cuối cùng, chúng thực sự được tích hợp vào chính mô hình cơ sở để bạn không thực sự cần một bước kỹ thuật nhắc nhở phức tạp."

Các kỹ sư lời nhắc vẫn sẽ tồn tại – theo cách nào đó

Mặc dù vậy, ngay cả khi các lời nhắc được tự động hóa, các kỹ sư lời nhắc vẫn sẽ tồn tại – nhưng có thể dưới một cái tên khác – đó là nhận định của Tim Cramer, phó chủ tịch kỹ thuật phần mềm của Red Hat. Việc điều chỉnh các mô hình AI là một nỗ lực phức tạp, gồm nhiều giai đoạn và sẽ tiếp tục đòi hỏi con người tham gia trong tương lai gần.

Các mô hình AI có thể tự huấn luyện và tự đưa ra lời nhắc để cải thiện hiệu suất

Ông Cramer cho biết: "Tôi nghĩ các kỹ sư lời nhắc vẫn sẽ cần đến trong thời gian tới, giống như các nhà khoa học dữ liệu. Nhiệm vụ của họ không chỉ là đặt câu hỏi cho các LLM (mô hình ngôn ngữ lớn) mà còn đảm bảo câu trả lời hoàn chỉnh. Có rất nhiều việc cần phải có các kỹ sư thực sự mới có thể làm được."

Ông Austin Henley, cựu kỹ sư Microsoft về dự án Copilot, cho biết: "Rất dễ để tạo ra một nguyên mẫu. Cái khó là sản xuất ra nó." Kỹ thuật lời nhắc giống như một mảng ghép hình khổng lồ của một nguyên mẫu mà các kỹ sư đang xây dựng nên. Nhưng nếu muốn tạo ra một sản phẩm thương mại từ nguyên mẫu đó, các công ty cần đảm bảo độ tin cậy, an toàn, quyền riêng tư và khả năng tuân thủ - đây là các công việc mà máy móc hay phần mềm khó có thể thay thế con người.

Để hoàn thành các nhiệm vụ này, nhiều công ty lớn đang đặt ra chức danh mới cho công việc đó: Người Vận hành Mô hình Ngôn ngữ Lớn (Large Language Model Operations hay LLMOps). Nhiệm vụ của họ không chỉ thành thạo các lời nhắc mà còn thực hiện các nhiệm vụ cần thiết để triển khai sản phẩm. Thậm chí với tốc độ biến đổi nhanh như hiện tại, chức danh và nhiệm vụ của họ sẽ tiếp tục biến đổi trong tương lai, dù bản chất vẫn là người tương tác với các mô hình AI đó.

Ông Cramer nói: "Tôi không biết liệu chúng ta sẽ kết hợp nó với một loại công việc hoặc vai trò công việc khác hay không, nhưng tôi không nghĩ rằng những công việc này sẽ sớm biến mất. Và hoàn cảnh hiện tại đang quá điên rồ. Mọi thứ thay đổi quá nhiều. Chúng ta sẽ không thể hình dung được mọi thứ trong vài tháng nữa."